Smartsign Sign Language AI

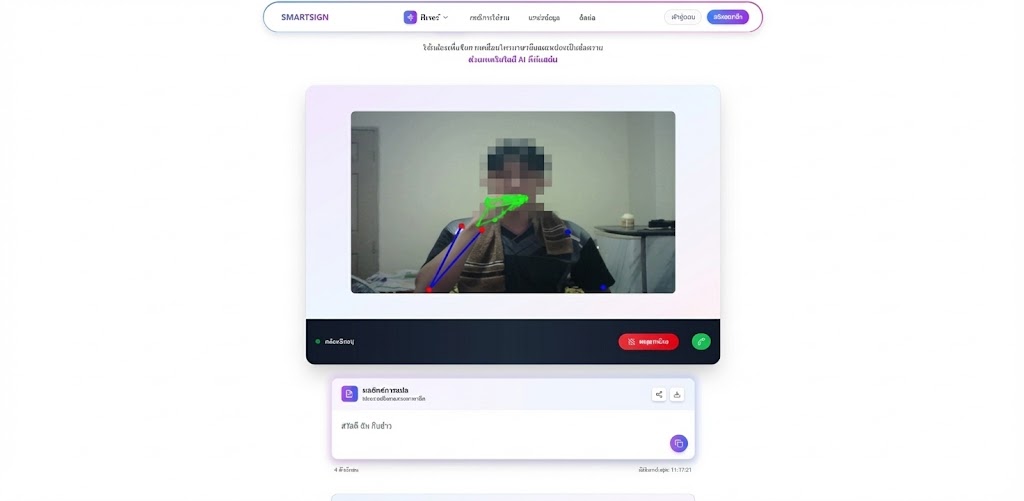

ระบบแปลภาษามือแบบเรียลไทม์ ตรวจจับ skeleton ด้วย MediaPipe + CNN, จับ sequence ด้วย LSTM และใช้ MLP รวมสัญญาณ ก่อนทำ NLP เพื่อถอดความเป็นข้อความและเสียง

LSTM

MediaPipe

CNN

MLP

NLP

Vue

Python

ย้อนกลับ

สถาปัตยกรรมโมเดล

MediaPipe Pose

ดึง keypoints ของมือ/ลำตัวแบบเรียลไทม์เพื่อป้อนให้ CNN และ LSTM

CNN + MLP

แปลงเฟรมเดี่ยวเป็น embedding และใช้ MLP รวมฟีเจอร์มือทั้งสองข้าง

LSTM Sequence

เรียนรู้ลำดับท่าทางภาษามือ ต่อเนื่องหลายเฟรมเพื่อเพิ่มความแม่นยำ

NLP Output

แมปสัญญาณเป็นข้อความ พร้อม text-to-speech ส่งออกเสียงตอบกลับ

ตัวอย่างผลงาน